J'ai vu des taux de détection de l'IA passer de 98% à 60% sur des projets réels. La cause première était toujours la même : de mauvais réglages du temps de séjour dans la trajectoire de croisière de la PTZ.

La précision du temps d'arrêt dans les trajectoires de croisière permet de contrôler le nombre d'images claires et stables que le moteur d'IA obtient à chaque position prédéfinie. Si le temps d'arrêt est trop court, s'il commence trop tôt ou s'il change entre les cycles, l'IA manquera des cibles, créera des faux négatifs et donnera des résultats d'analyse peu fiables sur l'ensemble du site.

Ci-dessous, je présente les besoins exacts en matière de synchronisation, les méthodes de synchronisation, les risques de détection des temps d'arrêt courts et les astuces d'optimisation que tout intégrateur devrait connaître avant de déployer des caméras PTZ dotées d'un système d'IA.

Combien de secondes d'attente sont nécessaires à l'IA pour analyser une nouvelle scène ?

J'avais l'habitude de régler le temps d'attente à 2 secondes et de me demander pourquoi mon IA manquait toujours la moitié des cibles. Les mathématiques m'ont montré pourquoi.

La plupart des algorithmes d'intelligence artificielle ont besoin d'au moins 3 à 5 secondes de stabilité à chaque préréglage. Les premières 0,5 à 1 seconde sont consacrées à la stabilisation mécanique et à l'autofocus. Le reste fournit les images claires consécutives dont l'IA a besoin pour une détection et une confirmation fiables de la cible.

Comprendre le budget temps de chaque présélection

Lorsqu'une caméra PTZ arrive à une nouvelle position prédéfinie, plusieurs choses doivent se produire avant que l'intelligence artificielle ne puisse faire quoi que ce soit d'utile. Tout d'abord, le moteur s'arrête. Mais le corps de la caméra ne s'arrête pas instantanément. Il y a toujours une vibration physique due à l'arrêt soudain. Cette vibration peut durer de 0,3 à 0,5 seconde sur la plupart des unités PTZ commerciales. Pendant cette période, chaque image capturée par la caméra présente un flou de mouvement. Les modèles d'IA tels que YOLO 1 ou tout autre détecteur accéléré par TensorRT a besoin de bords nets pour trouver les objets. Les images floues sont inutiles.

Une fois que les vibrations se sont calmées, le système de mise au point automatique entre en action. Même rapide PDAF (autofocus à détection de phase) 2 prend environ 0,3 à 0,5 seconde pour se verrouiller sur la scène. Jusqu'à ce que la mise au point soit effectuée, l'image est floue. L'IA ne peut pas extraire des caractéristiques telles que la structure du visage ou les caractères de la plaque d'immatriculation à partir d'une image molle.

Ce n'est qu'une fois la stabilisation et la mise au point effectuées que l'IA obtient des images exploitables. Voici comment le budget temps se décompose pour chaque préréglage :

| Phase | La durée | Ce qui se passe | Facilité d'utilisation de l'IA |

|---|---|---|---|

| Stabilisation mécanique | 0,3-0,5 sec | Le moteur s'arrête, les vibrations s'atténuent | ❌ Les images sont floues |

| Verrouillage de l'autofocus | 0,3-0,5 sec | L'objectif s'adapte à la nouvelle profondeur de la scène | ❌ L'image est molle |

| Fenêtre de capture de l'IA | 2-3 sec | Un flux de trames clair et stable pour l'IA | ✅ Valide pour la détection |

| Zone tampon / zone de réessai | 0,5-1 seconde | Gère les retards du réseau ou les tentatives de réessai de l'algorithme | Marge de sécurité |

| Total recommandé | 3-5 secondes | — | — |

Pourquoi 2 secondes ne suffisent presque jamais

Je parle à des intégrateurs qui fixent le temps d'arrêt à 2 secondes parce qu'ils veulent couvrir plus de préréglages en un seul cycle de croisière. La logique semble saine - plus d'arrêts signifie plus de couverture. Mais la réalité est différente.

Si le temps d'arrêt total est de 2 secondes et que la caméra consacre 0,5 seconde à l'amortissement des vibrations et 0,5 seconde à la mise au point automatique, l'IA n'obtient qu'une seconde d'images claires. À 15 FPS, cela ne représente que 15 images. La plupart des algorithmes d'IA utilisent une méthode de vote sur plusieurs images. Ils doivent voir une cible sur au moins 3 à 5 images consécutives avant de la considérer comme “confirmée”. Avec seulement 15 images et d'éventuels obstacles ou changements d'éclairage, l'algorithme ne parvient souvent pas à boucler sa boucle de détection, de suivi et de confirmation.

Le résultat est simple. L'IA voit quelque chose, mais elle n'a pas assez de données pour dire “oui, c'est une personne” ou “oui, c'est un véhicule”. Elle reste donc silencieuse. Et l'opérateur ne reçoit jamais l'alerte.

Est-il possible de synchroniser le déclenchement de la détection de l'IA avec l'arrivée de la caméra sur un site prédéfini ?

Une fois, j'ai passé une semaine entière à déboguer des détections manquées dans le cadre d'un projet de périmètre. L'IA déclenchait son balayage avant même que la caméra ait fini de faire la mise au point.

Oui, la synchronisation est possible. Mais le déclenchement de la détection de l'IA doit commencer après que la caméra a confirmé la stabilisation mécanique et le verrouillage de l'autofocus. L'erreur d'intégration la plus fréquente consiste à lancer le balayage AI au moment de l'envoi de la commande de déplacement, et non lorsque la caméra signale que la position est atteinte et que la mise au point a été effectuée.

Différence entre “Commande envoyée” et “Position confirmée”.”

C'est là que de nombreux projets échouent. Dans la plupart des systèmes de contrôle PTZ, il y a deux événements distincts. Le premier événement est la “commande envoyée”. C'est le moment où le contrôleur demande à la caméra de passer à la présélection 5. Le second événement est la “position confirmée”. C'est le moment où la caméra signale qu'elle est arrivée, qu'elle s'est arrêtée et qu'elle a verrouillé la mise au point.

Le problème est que de nombreuses plateformes NVR et VMS démarrent le décompte du temps d'arrêt à partir de la “commande envoyée”. Cela signifie que l'horloge tourne déjà alors que la caméra est encore en train de tourner. Lorsque la caméra s'arrête et fait la mise au point, une grande partie du temps d'arrêt est déjà écoulée.

Je recommande toujours de vérifier si votre protocole PTZ prend en charge un rappel ou un indicateur d'état “position atteinte”. ONVIF Profil S 3, par exemple, prend en charge les requêtes sur l'état des positions prédéfinies. Si votre système peut lire cet indicateur, vous pouvez élaborer une règle logique simple. La règle dit : “Ne démarrez pas le balayage AI tant que la caméra n'a pas confirmé qu'elle se trouve à la position cible et que la mise au point est verrouillée”.”

Comparaison des différentes méthodes de synchronisation

Tous les systèmes PTZ n'offrent pas le même niveau de synchronisation. Voici une comparaison des approches les plus courantes que j'observe sur le terrain :

| Méthode de synchronisation | Comment ça marche | Pour | Cons |

|---|---|---|---|

| Basé sur une minuterie (délai fixe) | Démarre le balayage de l'IA X secondes après l'ordre de déplacement | Simple à mettre en place | Ne s'adapte pas aux temps de déplacement variables |

| Consultation de l'état ONVIF | Vérifie l'indicateur d'état prédéfini toutes les 200 ms | Précision pour les caméras prises en charge | Ajoute une légère surcharge au réseau |

| Déclenché par le codeur | L'IA démarre lorsque l'encodeur confirme la stabilité de la vidéo | Très fiable | Nécessite une intégration au niveau du codeur |

| Calibrage manuel | L'opérateur teste et règle le délai par préréglage | Fonctionne sur tous les systèmes | Prend du temps, n'est pas extensible |

Mon approche préférée

Pour les projets dans lesquels j'utilise nos caméras PTZ Loyalty-Secu, je préfère la méthode déclenchée par l'encodeur. Nos caméras signalent un drapeau vidéo stable une fois que le moteur s'est arrêté et que le cycle PDAF est terminé. Cet indicateur passe par les métadonnées du flux RTSP. Le backend AI lit ce drapeau et ne démarre sa fenêtre de détection qu'après l'avoir reçu. De cette manière, je ne perds jamais de temps sur des images floues ou mal cadrées. Chaque seconde de temps d'attente est une seconde productive pour l'IA.

Si le VMS ne prend pas en charge l'analyse des métadonnées, je me rabats sur une méthode de délai fixe. Mais j'ajoute toujours une marge de sécurité d'une seconde au temps de stabilisation mesuré. Il vaut mieux perdre une seconde de couverture que de perdre la totalité de la détection à ce préréglage.

Un temps d'attente court peut-il faire manquer à mon IA des alertes de détection de personnes ou de véhicules ?

Un client m'a appelé à 2 heures du matin parce que l'IA de son périmètre avait manqué un intrus qui traversait un parking. Le temps d'attente était réglé sur 1,5 seconde.

Oui. Un temps d'attente trop court entraîne directement des détections manquées. Les algorithmes d'intelligence artificielle utilisent le vote sur plusieurs images pour confirmer les cibles. Si la caméra s'éloigne avant que l'algorithme n'ait terminé son cycle détection-pistage-confirmation, le système produira des faux négatifs. Les menaces réelles traversent la scène sans être détectées.

Comment fonctionne le vote à trames multiples ?

La plupart des systèmes modernes de détection de l'IA ne s'appuient pas sur une seule image. Une seule image peut contenir des ombres, des reflets ou des formes bizarres qui ressemblent à une personne mais n'en sont pas. Pour éviter ces fausses alertes, l'IA utilise une méthode appelée vote multi-images.

Le processus se déroule comme suit. L'IA exécute son modèle de détection sur l'image 1. Elle trouve une forme qui ressemble à un humain avec 72% de confiance. Elle ne déclenche pas encore d'alerte. Sur l'image 2, elle trouve la même forme dans une position similaire avec un niveau de confiance de 78%. Sur l'image 3, 81%. Sur l'image 4, 85%. Après avoir vu la cible dans 3 à 5 images consécutives avec une confiance croissante ou stable, l'algorithme la marque comme “cible confirmée” et envoie l'alerte.

Ce processus prend du temps. À 15 FPS, cinq images prennent environ 0,33 seconde. Cela semble rapide. Mais n'oubliez pas qu'il ne s'agit que de l'étape du vote. Avant que le vote ne commence, l'algorithme doit également initialiser son tracker, construire une boîte de délimitation et comparer la cible à ses classes modèles. La boucle complète détection-pistage-confirmation prend souvent 1 à 2 secondes de vidéo propre.

Ce qui se passe lorsque vous écourtez le cycle

Si le temps d'arrêt n'est que de 1,5 seconde et que les 0,8 premières secondes sont perdues pour la stabilisation et la mise au point, l'IA n'obtient que 0,7 seconde de vidéo propre. Cela représente environ 10 images à 15 FPS. L'algorithme commence sa détection sur l'image 1. À la cinquième image, il prend confiance. À l'image 10, il pourrait être proche de la confirmation. Mais la caméra bouge. La cible disparaît de l'image. Le traqueur perd l'objet. Le score de confiance est réinitialisé.

L'IA ne déclenche jamais l'alerte. La cible était là. La caméra l'a vue. Mais l'algorithme n'a pas eu le temps de dire “confirmé”. Il s'agit d'un faux négatif. Et les faux négatifs sont bien plus dangereux que les faux positifs. Un faux positif est une alerte supplémentaire gênante. Un faux négatif est un intrus manqué.

L'impact sur les différentes tâches de détection

Toutes les tâches d'IA n'ont pas les mêmes besoins en termes de temps. La reconnaissance des plaques d'immatriculation (LPR) est plus exigeante que la simple détection humaine, car l'algorithme doit lire des caractères individuels. Voici un guide approximatif basé sur mon expérience de projet :

| Tâche AI | Nombre minimum d'encadrements nécessaires | Temps d'attente effectif minimum | Risque si le temps de séjour est trop court |

|---|---|---|---|

| Détection humaine | 3-5 cadres | 2-3 sec | Alertes d'intrusion manquées |

| Détection des véhicules | 3-5 cadres | 2-3 sec | Registres d'entrée des véhicules manquants |

| Reconnaissance des plaques d'immatriculation | 8-15 cadres | 4-5 sec | Caractères de la plaque illisibles |

| Reconnaissance des visages | 10-20 cadres | 5-7 secondes | Échec de la correspondance des identités |

| Analyse comportementale (flânerie) | 30+ cadres | 5-10 sec | Faux calculs du temps de flânerie |

Ce tableau montre clairement une chose. Plus l'IA doit extraire de détails, plus elle a besoin de temps. Et ce temps doit être propre, stable et concentré. Il n'y a pas de raccourci.

Comment optimiser le programme de croisière pour équilibrer la zone de couverture et la précision de l'IA ?

Je dis toujours ceci à mes clients : plus de préréglages ne signifie pas une meilleure sécurité. Parfois, moins d'arrêts avec des temps d'attente plus longs donnent de bien meilleurs résultats dans le monde réel.

Pour équilibrer la zone de couverture et la précision de l'IA, réduisez le nombre de préréglages aux seules zones hautement prioritaires, accordez à chaque arrêt un temps d'arrêt d'au moins 5 secondes et suivez la règle des 5 secondes - 1 seconde pour la stabilisation, 3 secondes pour la capture de l'IA et 1 seconde pour la protection contre les retards de réseau ou de traitement.

La règle des 5 secondes

J'utilise un cadre simple pour chaque chemin de croisière que je configure. Je l'appelle la règle des 5 secondes. Elle divise chaque période d'attente en trois phases :

- Deuxième 1 : L'appareil photo se stabilise. Les vibrations du moteur s'arrêtent. Le PDAF verrouille la mise au point. Aucun travail d'IA utile ne se produit ici.

- Secondes 2 à 4 : Il s'agit de la fenêtre principale de capture de l'IA. À 15 FPS, l'IA obtient 45 images nettes. C'est suffisant pour la détection humaine, la détection de véhicules et même la RPM de base dans de bonnes conditions d'éclairage.

- Deuxième 5 : Il s'agit de la zone tampon. Elle gère la latence du réseau entre la caméra et le NVR, les cycles de réessai de l'algorithme et les retards mineurs d'encodage.

Cette règle n'est pas parfaite pour tous les scénarios. Pour la reconnaissance faciale ou l'analyse comportementale, j'augmente le temps d'attente à 7 ou même 10 secondes. Mais pour un périmètre de sécurité standard avec détection de personnes et de véhicules, 5 secondes par préréglage est une base solide.

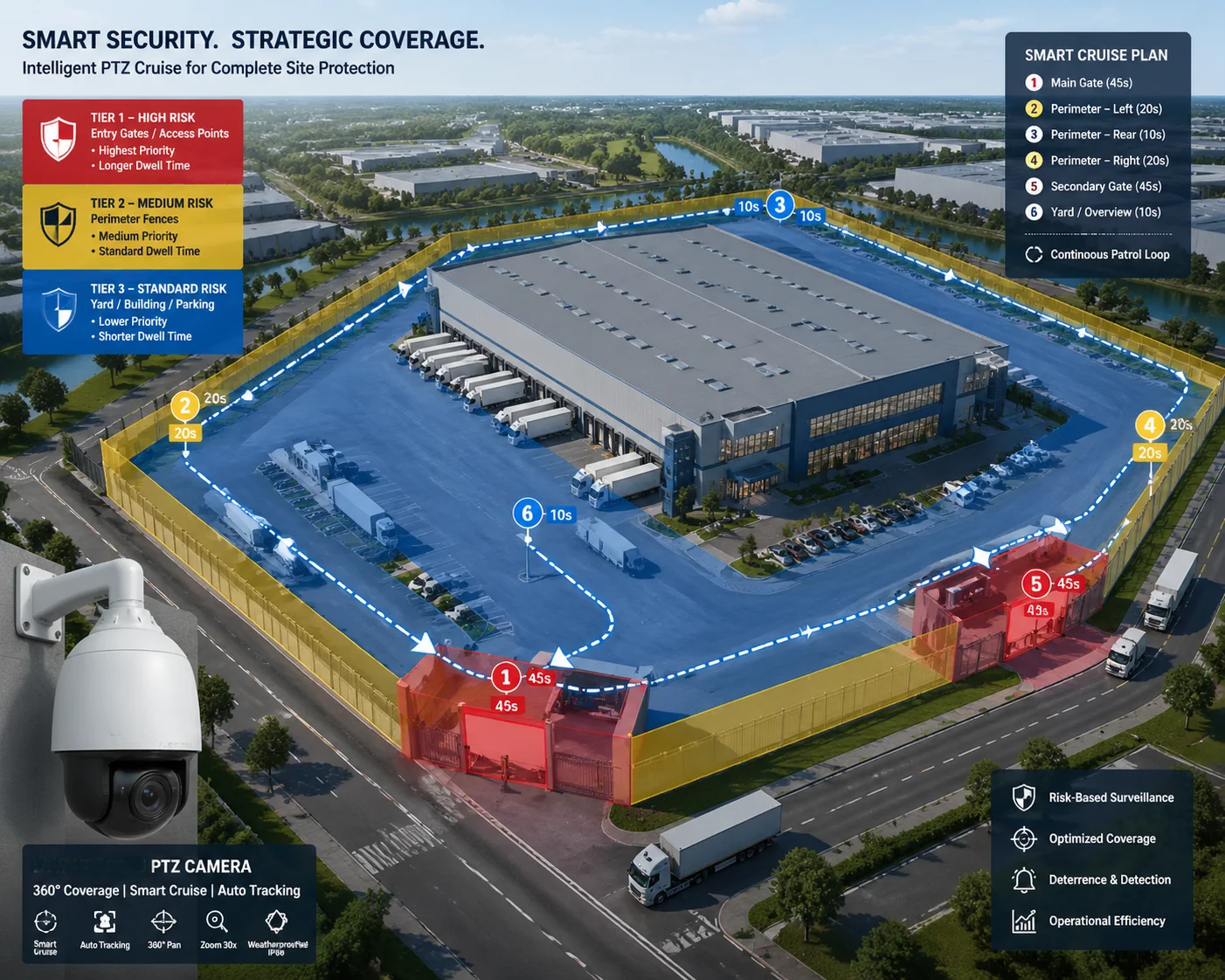

Hiérarchisation des préréglages par niveau de risque

Toutes les zones d'un établissement ne requièrent pas la même attention. Une porte d'entrée principale nécessite plus de temps d'arrêt qu'un mur latéral silencieux. Je recommande de classer toutes les positions prédéfinies en trois niveaux de priorité :

- Niveau 1 (risque élevé) : Points d'entrée, parkings, quais de chargement. Le temps d'attente est de 7 à 10 secondes.

- Niveau 2 (risque moyen) : Les lignes de clôture, les couloirs secondaires, les zones de stockage. Ces éléments bénéficient de 5 secondes.

- Niveau 3 (faible risque) : Champs ouverts sans atouts, zones décoratives. Ces zones bénéficient de 3 secondes ou sont entièrement retirées de la trajectoire de croisière.

En réduisant le nombre total de préréglages et en accordant plus de temps aux préréglages importants, le cycle de croisière s'achève plus rapidement et l'IA dispose de suffisamment de données à chaque point critique. J'ai constaté que cette approche permettait d'augmenter les taux de détection globaux de 20% à 30% sur des sites qui utilisaient auparavant 15 préréglages ou plus avec des temps d'attente de 2 secondes pour l'ensemble.

Maintenir un temps d'arrêt constant entre les cycles

Je vérifie toujours si le temps d'arrêt reste le même d'un cycle à l'autre. Certains contrôleurs PTZ bon marché présentent une dérive de la temporisation. Ils peuvent maintenir un préréglage pendant 5 secondes lors du premier cycle et 3,2 secondes lors du cycle suivant. Cette incohérence perturbe les analyses d'IA qui dépendent de règles basées sur le temps, comme la détection de la flânerie ou la mesure de la durée de la file d'attente.

Si votre système PTZ présente une dérive temporelle, je vous suggère de passer à un contrôleur ou à un NVR qui utilise une programmation précise basée sur l'ONVIF. Vous pouvez également utiliser nos caméras PTZ Loyalty-Secu, qui disposent d'un moteur de croisière intégré avec une cohérence de temps d'arrêt de l'ordre de la milliseconde. Cela supprime la dépendance à l'égard d'un contrôleur externe et garantit que chaque cycle est identique.

La précision du retour des préréglages est également importante

Même si la durée d'immobilisation est parfaite, l'IA échouera si la caméra ne revient pas exactement au même angle à chaque fois. Si la présélection 5 pointe à 45,0° lors du premier cycle et à 45,3° lors du cycle suivant, la plage de détection virtuelle que vous avez dessinée dans le VMS se déplacera dans le cadre. Les objets qui devraient se trouver à l'intérieur de la zone tomberont à l'extérieur. La règle AI ne se déclenche pas.

Les caméras PTZ haut de gamme offrent une précision de retour prédéfinie de ±0,1° ou mieux. Le cadrage de la scène reste ainsi identique sur des centaines de cycles. Chez Loyalty-Secu, nos caméras sont construites selon cette norme. La combinaison d'un temps d'arrêt stable et d'un retour de préréglage précis donne à l'IA la cohérence dont elle a besoin pour fonctionner de manière fiable, jour après jour.

Conclusion

La précision du temps d'arrêt n'est pas un simple paramètre PTZ. C'est la base qui détermine si les détections de l'IA sont fiables ou inutiles. Si la durée est correcte, l'intelligence artificielle fonctionne. Si vous vous trompez, vous payez pour un système intelligent qui agit en aveugle.

1. Traitement multi-images de la détection d'objets en temps réel YOLO. ︎ 2. Temps de stabilisation de l'autofocus à détection de phase pour les caméras PTZ. ︎ 3. Requête sur l'état de la position préréglée du profil S de l'ONVIF. ︎ 4. Vote multi-images pour la réduction des faux positifs en IA. ︎ 5. Temps d'amortissement des vibrations de stabilisation du moteur pour les têtes PTZ. ︎ 6. Reconnaissance des visages temps d'attente minimal pour l'extraction des caractéristiques. ︎ 7. Cadres de confirmation des caractères de reconnaissance des plaques d'immatriculation. ︎ 8. Précision du calcul de la fenêtre temporelle de détection du flânage. ︎ 9. Métadonnées ONVIF pour la position PTZ et l'état de la mise au point. ︎ 10. Tolérance de précision de retour prédéfinie pour les plages de détection virtuelles. ︎